Missbrauch ohne Ende

Pädokriminelle Inhalte fluten das Netz - und die Polizei schaut zu

Deutschland gilt beim Kampf gegen Pädokriminalität im Netz als führend. In keinem anderen Land schalten Polizeibehörden so häufig Darknetforen ab. Doch die Erfolgsmeldungen sind nur die halbe Wahrheit.

Strafverfolgungsbehörden schauen seit Jahren zu, wie Pädokriminelle im Darknet Fotos und Videos verbreiten, obwohl diese sich löschen ließen. Politiker:innen in Bund und Ländern wissen das – und haben in einem geheimen Votum der Innenministerkonferenz beschlossen, dass sich daran nichts ändern soll. "Täter fassen, Bilder stehen lassen", ist die Quintessenz dieser Behördenpraxis.

In einem weltweit einzigartigen Projekt haben das ARD-Magazin Panorama und das Rechercheformat STRG_F (NDR/funk) Millionen Daten erhoben, die den Aufstieg pädokrimineller Darknetforen globalen Ausmaßes nachzeichnen. Sie belegen: Das Nicht-Löschen der Missbrauchsdarstellungen ist der eigentliche Treiber ihres scheinbar unaufhaltsamen Wachstums. Dabei wäre es so einfach, der pädokriminellen Szene den Boden zu entziehen.

Das Problem

Statistisch betrachtet sitzen in jeder deutschen Schulklasse ein bis zwei Kinder, die sexualisierter Gewalt ausgesetzt sind. Abstrakte Zahlen, hinter denen sich individuelle Schicksale verbergen.

Eva Winter (Name geändert) wurde in ihrer Kindheit und Jugend über Jahre hinweg schwer sexuell missbraucht. Die Täter, überwiegend männlich, machten davon Fotos und Videos.

Eva Winters Sorgen sind berechtigt. In pädokriminellen Darknetforen findet sich nahezu alles: von kleinen Babys bis jugendlichen Opfern, von harmlosen Kinderfotos bis schwerem Missbrauch, von Livestreams bis Jahrzehnte alten Aufnahmen.

In diesem Fall verbreitete ein Nutzer noch 2023 Fotos aus dem Jahr 2000, die er auf einer alten Festplatte gefunden hatte. Er lud die Aufnahmen jedoch nicht im Darknetforum selbst hoch, sondern bei Cloudanbietern im gewöhnlichen Internet – Anonfiles und Bayfiles. Beide Anbieter gibt es nicht mehr, weshalb wir diesen Screenshot zeigen können. Im Forum teilte der Nutzer nur die Download-Links und das Passwort zur Entschlüsselung: "all we need is love".

Warum dieser "Umweg" übers Clearweb? Die pädokriminelle Darknetszene ist Opfer ihres eigenen Erfolgs geworden. Sie hat zu viele Daten, um sie schnell im Darknet zu tauschen oder dort zu speichern. Pädokriminelle laden ihre Fotos und Videos daher verschlüsselt in Clouds hoch. Speicherort ist nicht das Darknet, sondern das gewöhnliche Clearweb.

Im Darknet tauschen Pädokriminelle nur die Informationen, wo im Clearweb ihre verschlüsselten Daten liegen.

Es ist paradox: Ohne das Clearweb könnten pädokriminelle Darknetforen niemals so groß werden, wie sie aktuell sind. Alle Versuche von Administratoren, die Inhalte in ihrem Darknetforum selbst zu speichern, sind gescheitert.

2021 hatten Recherchen von Panorama, STRG_F und Spiegel gezeigt, wie effektiv es sein könnte, wenn die Downloadlinks den Cloudanbietern gemeldet würden. In einem einmaligen Versuch meldeten die beteiligten Journalisten rund 80.000 Links, die alle binnen 48 Stunden deaktiviert wurden. Das damals größte pädokriminelle Darknetforum Rindexxx wurde zu einer Plattform fast ohne Missbrauchsdarstellungen.

Warum machten deutsche Behörden diese einfache, aber effektive Arbeit nicht?

Verantwortliche Politiker:innen in Bund und Ländern versprachen Besserung. Bundesinnenministerin Nancy Faeser (SPD) sagte mehrfach, Prozesse im Bundeskriminalamt seien "umgestellt" worden, hier in der Talkshow "Markus Lanz" im Sommer 2022. Faeser wies immer wieder auf das Leid der Betroffenen hin, die ein Recht darauf hätten, dass die Bilder und Videos der Taten gelöscht würden.

Was die Innenministerin jahrelang verkündete, entsprach jedoch nicht der Wahrheit. Die Situation in den Darknetforen hat sich nicht verändert. Deutsche Polizeibehörden lassen weiterhin die Bilder und Videos bewusst im Netz - gedeckt von einem geheimen Beschluss der Innenministerkonferenz aus dem Jahr 2023.

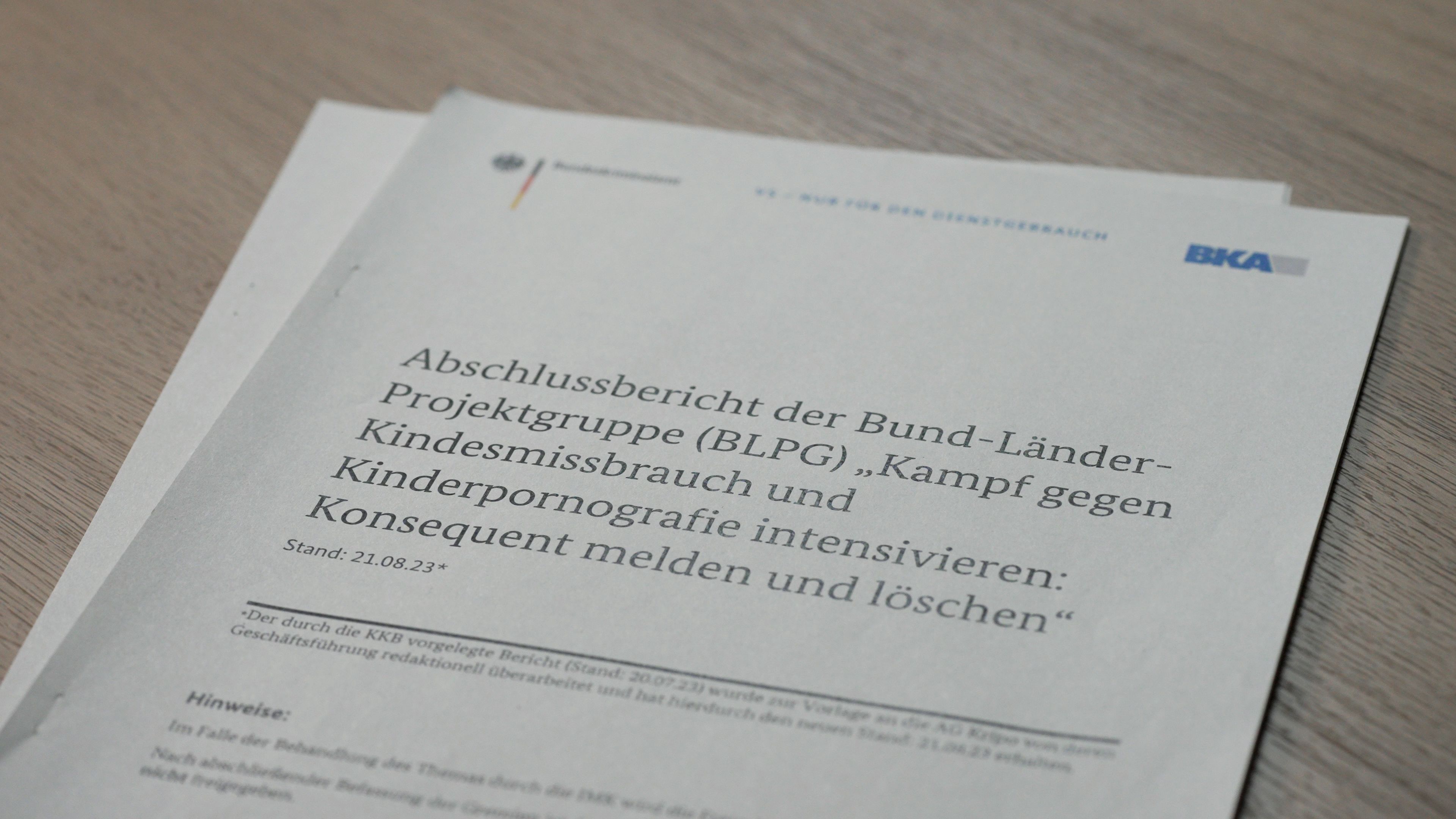

Eine sogenannte Projektgruppe aus Bund und Ländern erarbeitete im Auftrag der Innenministerkonferenz Szenarien, um im Darknet konsequent löschen zu lassen. Die Expert:innen erkannten in ihrem Abschlussbericht zwar das Potenzial der Methode an, sprachen sich aber dennoch dagegen aus.

Kernargument: Die aktuelle Rechtslage zwänge Staatsanwaltschaften dazu, tausende Verfahren einzuleiten, um die Verbreiter zu fassen - im Darknet ein aussichtsloses Unterfangen, für das den Behörden ohnehin das Personal fehle.

Ein politisch unbequemes Argument. Die Innenminister:innen der Länder trugen es mit, ließen den Abschlussbericht aber als geheim einstufen und vermittelten öffentlich den Eindruck, dass ihnen das Löschen wichtig sei, Prozesse verbessert worden seien – ohne ins Detail zu gehen.

Die Rechtslage ließen sie unverändert, auch Personalressourcen bei Polizei und Staatsanwaltschaften schufen sie für diese Löschmethode nicht. In den Darknetforen änderte sich daher, wenig überraschend, nichts.

Das Experiment

Stichproben im Frühjahr 2024 zeigten, dass in den Darknetforen weiterhin massenhaft Inhalte zum Download standen, die technisch betrachtet ins Clearweb führten – und deshalb gelöscht werden konnten. In diesem Fall entdeckten die Reporter Robert Bongen und Daniel Moßbrucker zum Beispiel ein Video, welches acht Jahre lang über denselben Link verfügbar war. Es zeigte laut Videobeschreibung den schweren sexuellen Missbrauch eines Mädchens durch den eigenen Vater.

Acht Jahre? Den Pädokriminellen war es egal, wenn zwischendrin Foren verschwanden, denn sie mussten nur die Links zu den Cloudanbietern kopieren und in neuen Foren posten.

Foren kamen und gingen - doch das Video des schwer missbrauchten Mädchens und viele tausend weitere blieben stets am gleichen Ort abrufbar.

Dass Polizeibehörden dem tatenlos zusehen, ist eine enorme Arbeitserleichterung für Pädokriminelle. Dies bestätigte sogar der ehemalige Administrator des 2021 abgeschalteten Forums BoysTown, der Panorama und STRG_F 2023 im Gefängnis ein Interview gegeben hatte.

Was Andreas G. aus dem Gefängnis heraus prophezeite, wurde Realität. In einem halbjährigen Experiment suchte ein Team aus Journalisten und Informatikern in den großen pädokriminellen Darknetforen nach Links zu Missbrauchsdarstellungen und meldete sie fortwährend den Cloudanbietern. Insgesamt deaktivierten die Unternehmen 310.199 Links, hinter denen sich entweder einzelne Bilder, ganze Alben oder Videos verbargen. Sie waren bis dahin über 23 Millionen Mal heruntergeladen worden und führten zu mehr als 21 Terabyte an Daten. Das ist so viel, als würde sich ein Mensch etwa eineinhalb Jahre lang ohne Pause Videos von Kindesmissbrauch im HD-Fernsehen ansehen.

Ein in Polizeikreisen immer wieder geäußertes Argument gegen das Löschen lautet, dass Pädokriminelle das Material dann immer wieder hochladen würden. Das Experiment zeigte jedoch, dass dieser Effekt nur kurzfristig in den ersten Wochen nach Beginn der Löschphase einsetzte.

Den Pädokriminellen stand durch das konsequente Löschen immer weniger Content zum Download bereit. Der Grund ist simpel: Wer ein Video anonym bei einem Cloudanbieter hochladen will, benötigt dafür meist mehrere Stunden. Wer es automatisiert beim Cloudanbieter meldet, nur wenige Sekunden.

Dieser Effekt zeigte sich auch bei den verfügbaren Bildern. Pädokriminelle verbreiten in den Foren häufig sogenannte Vorschaubilder zu ihren Videos. Das sind Schnappschüsse aus den Videos, damit Interessierte vor dem Download sehen können, was im Video passiert. Solche "Previews" sind ein entscheidender Faktor für die "Nutzerfreundlichkeit" eines Forums.

Die Daten zeigen die Entwicklung dreier Bilderdienste, die besonders intensiv genutzt wurden: dump.li, telegra.ph und zupimages.com. Zu Löschbeginn waren forenübergreifend etwa 47.000 Bilder bei diesen drei Diensten online, doch alle drei Anbieter reagierten rasch auf die Meldungen und entfernten sie. Obwohl die Pädokriminellen versuchten, durch erneutes Hochladen der Bilder das "Look-and-Feel" der Foren zu retten, belegen die Daten auch hier: Löschen geht schneller, als Daten hochzuladen.

Immer wieder war zu beobachten, dass die Cloudanbieter im Clearweb an Attraktivität verloren, sobald sie zu löschen begannen. Exemplarisch lässt sich dies am Dienst telegra.ph zeigen, der im Frühjahr 2024 von den Pädokriminellen "entdeckt" wurde und schnell zum beliebtesten Bilderdienst (sog. Imagehoster) aufstieg. Weil Behörden die Bilder nicht an den Betreiber von telegra.ph, den Messenger Telegram, meldeten, glaubten die Pädokriminellen, einen zuverlässigen Dienst gefunden zu haben. Die Uploadzahlen schossen in die Höhe – bis zum Löschbeginn Ende Juli. Sie sanken schon im Oktober wieder gen null, als klar wurde, dass telegra.ph schnell und umfassend löschte. Im Ergebnis verschwand Telegraph gänzlich von Empfehlungsseiten der Pädokriminellen.

Die Pädokriminellen realisierten etwa zwei Monate nach dem Löschbeginn am 26. Juli 2024, dass sich kollektiv etwas verändert hatte. Glaubten sie zunächst noch, dass ihnen nur einzelne Cloudanbieter auf die Schliche gekommen waren, schrieben User ab September von einem "Krieg", einer "Wüste" oder einer "existenziellen Krise".

Die Pädokriminellen wählten zwei Gegenstrategien: Einerseits intensivierten sie die Suche nach immer neuen Cloudanbietern, bei denen sie ihre Inhalte verschlüsselt hochluden. Ihre Hoffnung war, dass sie einen Dienst finden würden, der nicht auf die Meldungen reagierte. Die recherchierenden Journalisten meldeten die gefundenen Inhalte zu Beginn bei etwa einem Dutzend Anbietern, zum Ende der Löschphase waren es über 50, weil die Pädokriminellen immer neue Anbieter ausprobierten. Allerdings gab es keinen Anbieter, der gar nicht reagierte, manche benötigten anfangs jedoch einige Tage oder Wochen, weil sie es offensichtlich nicht gewohnt gewesen waren, auf illegale Inhalte hingewiesen zu werden.

Einige Cloudanbieter implementierten, aufgeschreckt durch die andauernden Benachrichtigungen über illegale Inhalte, Schutzmaßnahmen wie sogenannte CAPCHTAs oder die Skriptsprache JavaScript, die Pädokriminelle aus Sorge um ihre Anonymität nicht zu nutzen bereit sind. Alle Anbieter, die solche Maßnahmen ergriffen, wurden für die Pädokriminellen sofort unattraktiv und die Zahl der Uploads sank auf null. Der französische Cloudanbieter 1Fichier.com forderte von den recherchierenden Journalisten die Passwörter für die verschlüsselten Dateien, damit die französische Polizei die Inhalte untersuchen könne. Die Journalisten erfassten diese Passwörter automatisiert mittels KI-Modellen, sodass in der Folge auch 1Fichier.com nach Jahren der Nutzung durch Pädokriminelle massiv zu löschen begann.

Andererseits begannen die Pädokriminellen, insbesondere die wichtigen Vorschaubilder für ihre Videos bei Darknet-Imagehostern hochzuladen. Technisch ist es möglich, auch im Darknet pädokriminelle Inhalte zu speichern, praktisch sind sie jedoch unbeliebt, weil diese Dienste meistens langsam sind und unbeständig laufen. Die kollektive "Flucht" zu diesen Darknet-Bilderdiensten erreichte enorme Ausmaße.

Die Grafik zeigt die in allen Foren verbreiteten Bilder über die fünf größten Darknet-Bilderdienste (sog. Imagehoster). Genau in dieser Massenbewegung lag jedoch der Knackpunkt: Die ohnehin schon kleinen Anbieter wurden regelrecht "überrannt", sodass sie im Tagesdurchschnitt viele Stunden lang gar keine Bilder mehr darstellten. Durchschnittlich lud ein Bild 30 bis 60 Sekunden, was selbst für das Darknet stark überdurchschnittliche Ladezeiten sind. Den recherchierenden Journalisten gelang es dann, diesen Effekt noch zu verstärken, indem die Darknetdienste durch leistungsfähige Server konstant mehrere tausend Anfragen pro Minuten erhielten. Im Ergebnis waren die Bilder gerade zu den Stoßnutzungszeiten nicht aufzurufen, was aus Nutzerperspektive den Eindruck verstärkte, dass "nichts funktionierte".

Die Reaktion auf das massenhafte Löschen bestand insofern einzig in Ausweichbewegungen auf andere Anbieter, erstaunlicherweise aber nicht in technischen Umstellungen der Foren. Obwohl die Nutzer registrierten, dass jemand kollektiv die Downloadlinks einsammelte, schienen die Administratoren technisch nichts mehr "in der Schublade" zu haben. Bis zum letzten Tag der Löschperiode gelang es den recherchierenden Journalisten, mit frei verfügbarer Software und KI-Modellen alle großen Darknetforen komplett auszuwerten.

Eine eigentlich Stärke der pädokriminellen Szene entpuppte sich in dieser Drucksituation als Schwachstelle: ihre hierarchische, starre Organisation. Es gibt feste Rollen in pädokriminellen Darknetforen, denen sich User zugehörig fühlen. Administratoren betreiben ein Forum und stellen Regeln auf, Moderatoren unterstützen sie im täglichen Betrieb und achten auf die Einhaltung der Regeln, Power-User oder Uploader stellen der Szene pädokriminelle Inhalte zum Download bereit und die Masse der Lurker (dt. etwa: Mitleser) konsumiert die Inhalte, ohne selbst pädokriminelle Inhalte zu verbreiten. Die Zahlen verdeutlichen dies eindrücklich: In einem Forum, welches später unter dem Druck des Löschens sogar aufgab, waren die zehn aktivsten Power-User für die Erstellung jedes dritten Beitrags, in denen pädokriminelle Inhalte verbreitet wurden, verantwortlich. Die recherchierenden Journalisten analysierten das Postingverhalten, die genutzten Cloudanbieter und die Schutztaktiken dieser Power-User vorrangig, um die Szene möglichst effektiv zu schwächen.

Nach wenigen Wochen sorgte die Nicht-Verfügbarkeit von pädokriminellen Inhalten für Zwietracht in der ansonsten eher solidarischen Szene. Power-User fühlten sich von den Administratoren im Stich gelassen, weil diese sich technisch nicht gegen die Analyse ihrer Foren zur Wehr setzten. Die sonst eher schweigsamen Lurker bedankten sich nicht mehr bei den Power-Usern für deren Postings, sondern beschwerten sich mit zunehmender Vehemenz darüber, dass nichts mehr funktionierte und das "Produktversprechen" der Foren, nämlich der Konsum pädokrimineller Inhalte, nicht eingehalten wurde. Dies wiederum ärgerte Power-User, die nicht länger bereit waren, viele Stunden ihres Tages für Uploads zu opfern, um sich dann dafür kritisieren zu lassen, dass ihr Einsatz immer noch nicht ausreiche, während die Lurker nur konsumieren wollten.

In allen User-Gruppen kam es zu Auflösungserscheinungen: Ein deutschsprachiger Lurker kündigte beispielsweise seinen "Ausstieg aus der Pädo-Szene" an, weil es "keinen Sinn" mehr mache. Power-User stellten ihre Uploads ein und manche Administratoren schalteten sogar ihre Foren ab, darunter mit BoysRus auch das zweitgrößte der Welt, das seit April 2022 existiert hatte. Dort war die Aktivität besonders dramatisch eingebrochen: Im Löschzeitraum sank die Zahl der neuen Beiträge, in denen Missbrauchsdarstellungen verbreitet wurden, durschnittlich um 80 Prozent pro Monat. Im Januar 2025 nahm der Administrator die Seite vom Netz.

Die Veranwortlichen

Offiziell gehören deutsche Behörden zu den schnellsten bei der Löschung sog. "kinderpornografischer Inhalte". Seit 2013 erstattet die Bundesregierung dem Bundestag jährlich Bericht über die Maßnahmen, die in Deutschland federführend vom Bundeskriminalamt und den sog. Beschwerdestellen wie jugendschutz.net umgesetzt werden.

2023 entfernten deutsche Stellen demnach 99 Prozent aller in Deutschland gespeicherten Missbrauchsdarstellungen in der Woche, nachdem sie darauf hingewiesen worden waren. Lagen die Inhalte im Ausland, waren nach vier Wochen in 88 Prozent der Fälle gelöscht worden.

Beeindruckende Zahlen, die aber nur einen Teil der Wahrheit widerspiegeln. Beim auch als "Löschen statt Sperren" bekannten Prozess entfernen deutsche Stellen vorrangig Inhalte, auf die sie "von außen" hingewiesen werden, beispielsweise wenn Privatpersonen auf Social Media illegale Inhalte entdecken und dies melden. Die Statistiken zu "Löschen statt Sperren" und im Jahresbericht von jugendschutz.net blenden Pädokriminalität im Darknet bewusst aus. Wieso? Stefan Glaser, Leiter von jugendschutz.net, verwies im Interview auf fehlende Zuständigkeit seines gemeinnützigen Unternehmens.

Eine Aufgabe der Polizei - dies bestreitet niemand. Insbesondere das BKA scheint prädestiniert für die Aufgabe zu sein, schließlich koordiniert es den Löschprozess mit den sog. Beschwerdestellen und fiel in den vergangenen Jahren immer wieder durch die Abschaltung pädokrimineller Darknetforen auf. Warum also handelt das BKA nicht?

Trotz des eindeutigen Datenbefunds und des geheimen Beschlusses der Innenministerkonferenz aus dem Jahr 2023 vermittelte Nancy Faeser, politisch verantwortlich für das BKA, im Interview mit Panorama und STRG_F noch im Dezember 2024 den Eindruck, dass sich die Lage verbessert habe, als sie zum sog. anlassunabhängigen Löschen in Darknetforen befragt wurde.

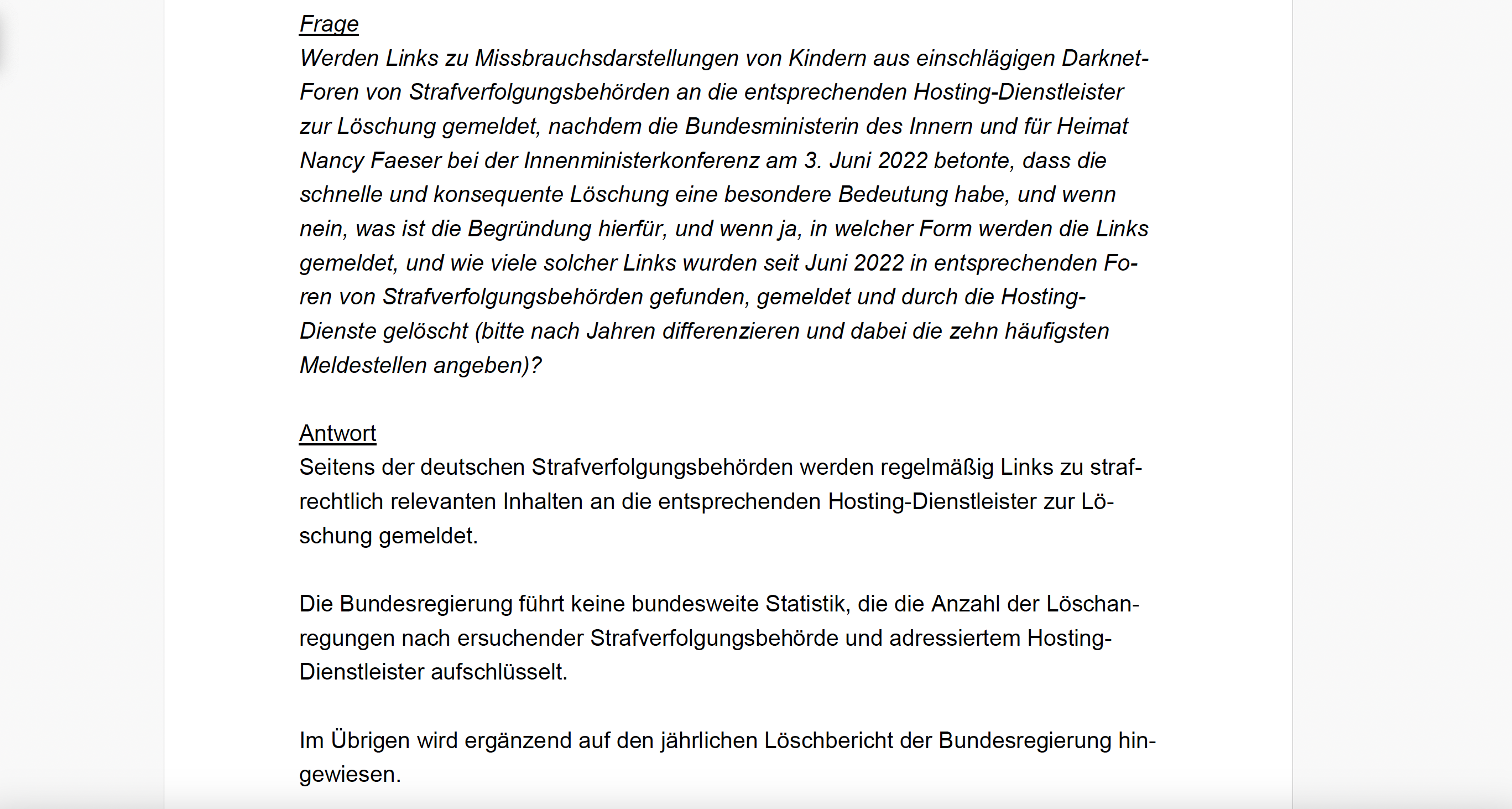

Öffentlich versuchte das Bundesinnenministerium auch auf Fragen von Bundestagsabgeordneten, hier Clara Bünger (Die Linke), immerzu den Eindruck zu vermitteln, dass das BKA im Darknet systematisch lösche.

Auch auf die explizite Nachfrage dazu antwortete das Bundeskriminalamt gegenüber Panorama und STRG_F im Januar 2025: "Bei der Optimierung der Prozesse wird auch die anlassunabhängige Recherche im Internet berücksichtigt."

Vage Statements, die suggieren sollen, was praktisch aber gerade nicht geschieht: anlassunabhängiges Löschen in pädokriminellen Darknetforen.

Einzig Herbert Reul (CDU), Innenminister in Nordrhein-Westfalen und politisch mitverantwortlich für den IMK-Beschluss aus dem Jahr 2023, räumte im Interview ehrlich ein, dass nichts passiert sei.

Die Folgen

In pädokriminellen Foren zirkulieren Listen, die einen Blick zurück erlauben. Sie zeigen, dass schon Anfang der 2000er-Jahre pädokriminelle Onlineforen entstanden, lange jedoch nur im Clearweb. Im Laufe der 2010er-Jahre wanderte die Szene dann ins Darknet ab. Warum? Die dahinterliegende Tor-Technologie wurde schneller und der Druck von Strafverfolgungsbehörden größer. Also begann die Szene, die Anonymität des Darknets, die eigentlich Journalist:innen, Dissident:innen und Whistleblower schützen soll, für ihre Zwecke zu missbrauchen.

Das erste pädokriminelle Darknetforum entstand der Liste zufolge um 2010 herum, ab 2013 wurden es immer mehr. Sie zeigt, dass die pädokriminelle Szene seit 2010 durchweg "versorgt" war mit Foren. Sie dienen primär dem Austausch der illegalen Dateien, bieten den Nutzer:innen aber gleichzeitig auch einen sozialen Raum, um sich mit Gleichgesinnten auszutauschen.

"Pädophilie ist keine Straftat" ist ein immer wieder auftauchender Slogan in den Foren. Dies ist korrekt. Niemand kann sich seine Sexualpräferenz freiwillig aussuchen und etwa ein Prozent der männlichen Bevölkerung ist wissenschaftlichen Schätzungen zufolge pädophil.

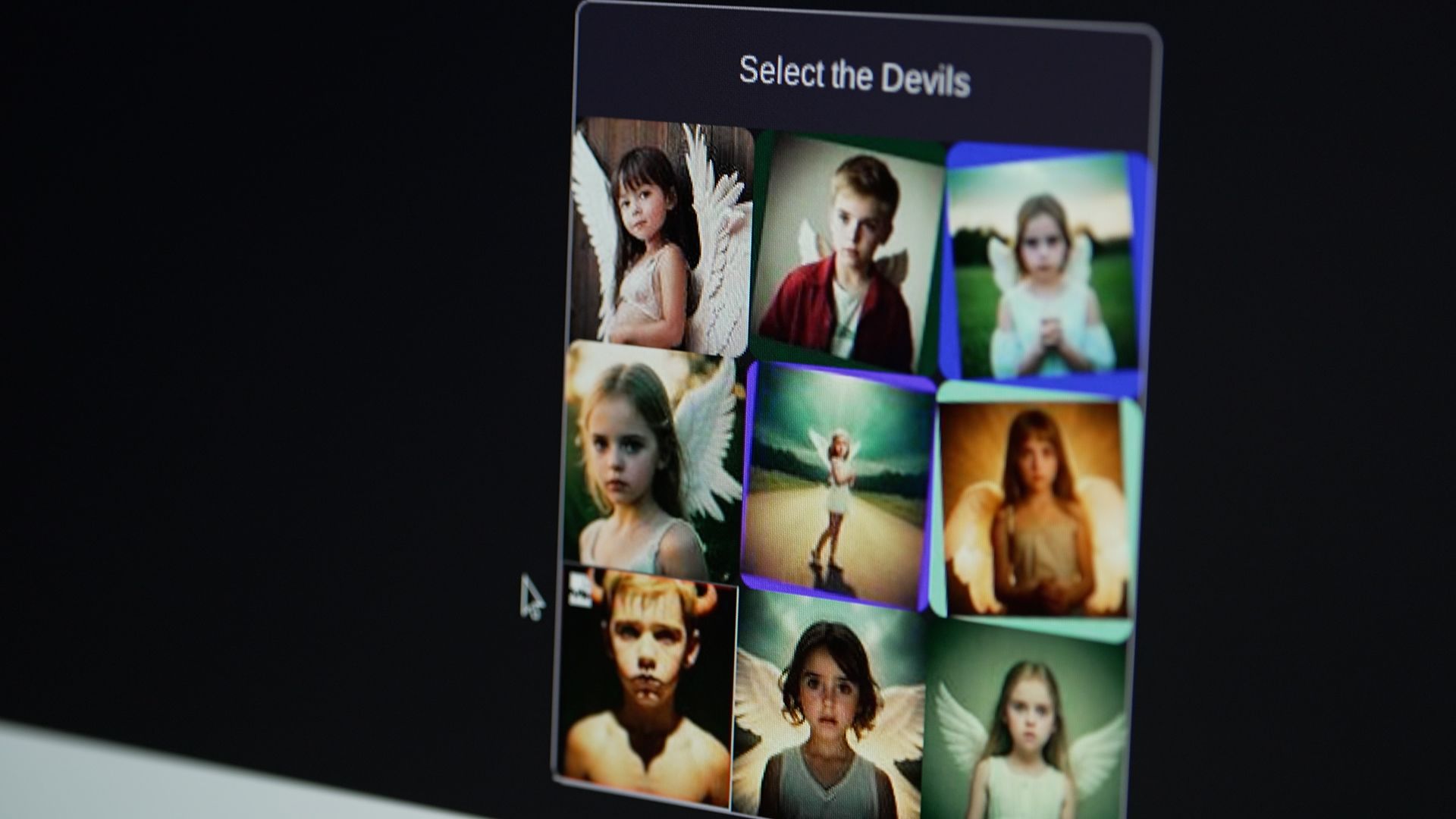

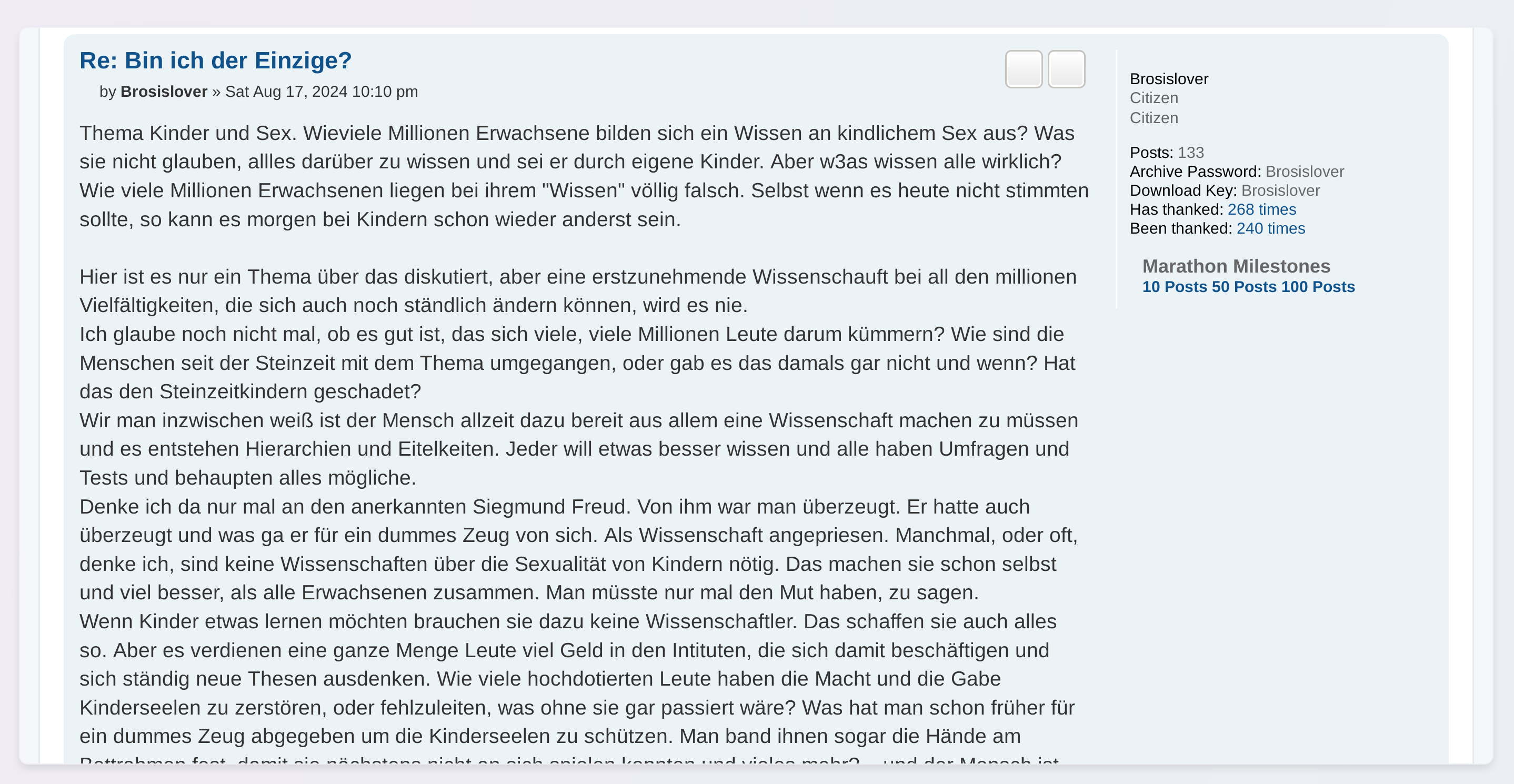

Doch die Nutzung der pädokriminellen Darknetforen ist an sich schon strafbar, Konsum und Austausch der Fotos und Videos erst recht. Es gilt unter Wissenschaftler:innen als psychologisch eindeutig herleitbar, dass der dauerhafte Besuch der Foren, der Austausch mit Gleichgesinnten und die ständige Verfügbarkeit des illegalen Materials einen enthemmenden Effekt haben kann. Die Foren vermitteln das Gefühl, dass es normal sei, die Missbrauchsdarstellungen zu konsumieren. Es zirkulieren sogar regelrechte Theorien, wonach die Pädokriminellen diejenigen seien, die Kindern eine "sexuelle Befreiung" böten, während die Gesellschaft dies fälschlicherweise kriminalisiere. Ansichten, die außerhalb der Foren nur Entsetzen auslösen können, dort jedoch den Mainstream repräsentieren. Es ist eine digitale Parallelgesellschaft entstanden, die ihren Mitgliedern nicht mehr das Gefühl vermittelt, etwas Schwerkriminelles zu tun.

Die Öffentlichkeit bekommt nur dann von der Existenz solcher Darknetforen mit, wenn sie von Behörden abgeschaltet werden. Promintestes Beispiel zuletzt war die Abschaltung von BoysTown 2021 durch die Generalstaatsanwaltschaft Frankfurt am Main und das Bundeskriminalamt. Solche Ermittlungsermittlungserfolge sind wichtig, weil sie die Drahtzieher der Foren vor Gericht stellt. Die Hoffnung der Strafverfolgungsbehörden ist auch, dass Festnahmen einen abschreckenden Effekt haben, damit weniger Menschen bereit sind, Foren zu betreiben. Wie erfolgreich ist das?

Die Daten sprechen eine eindeutige Sprache: In 15 Jahren gab es stetig mehr, nicht weniger pädokriminelle Darknetforen, ihre Nutzerzahlen sanken nicht, sondern stiegen, ihre Lebenszeit wurde nicht kürzer, sondern länger. Der Trend ist seit 2013 zu beobachten und verstärkte sich nochmals um 2019 herum. Wesentlicher Treiber, dies belegen die Daten und Aussagen mittlerweile verurteilter Forenbetreiber, ist die dauerhafte Verfügbarkeit des pädokriminellen Materials.

Es dauerhaft, konsequent und schnellstmöglich zu löschen, könnte die bisherige Strategie der Strafverfolgung ergänzen, die bisher vor allem darauf abzielt, die Täter:innen zu fangen.

Die Methode hätte das Potenzial, dies hat das halbjährige Pilotprojekt von Panorama und STRG_F gezeigt, das schier unaufhaltsame Wachstum der Foren zu stoppen – und die Rechte der Betroffenen zu wahren. Als sie in Interviews erfuhren, dass sich entgegen der politischen Versprechungen seit den ersten Enthüllungen 2021 nichts verändert hatte, empfanden sie dies als erneute Demütigung.

Missbrauch ohne Ende

Pädokriminelle Inhalte fluten das Netz - und die Polizei schaut zu